Deep Dive Técnico

1. Pipeline de Ingesta y Chunking Inteligente

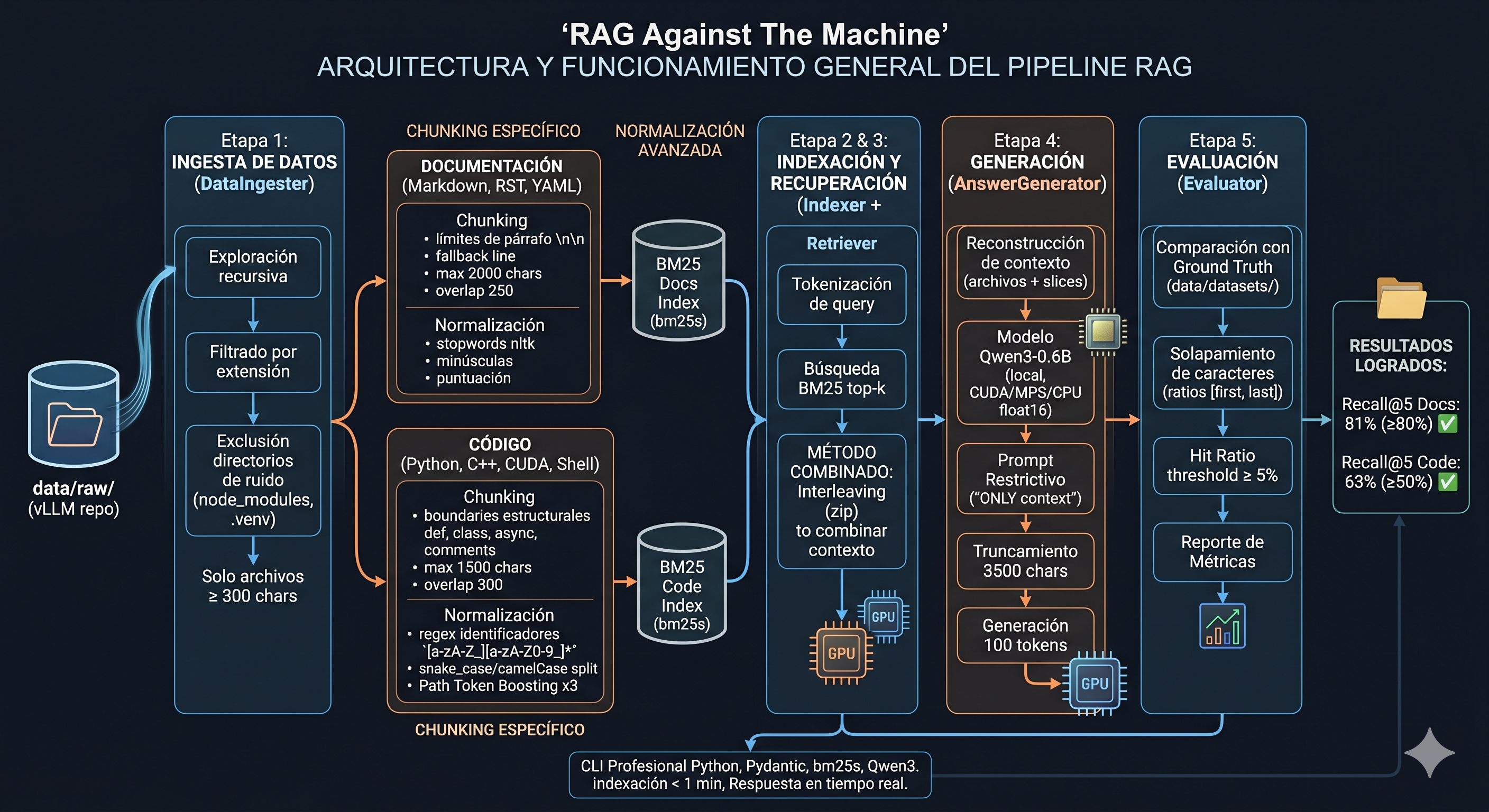

La calidad de un sistema RAG depende del contexto que recibe el LLM. Diseñé un chunking específico por tipo de archivo: para documentación (Markdown, RST, YAML) se dividen los chunks por límites de párrafo, mientras que para código (Python, C++, CUDA) los boundaries son estructurales — funciones, clases y bloques de comentarios. Además, implementé Path Token Boosting: los tokens extraídos de la ruta del archivo se repiten 3 veces en el corpus de código, aumentando la relevancia estructural (por ejemplo, un archivo paged_attention.py responde mejor a consultas sobre PagedAttention).

2. Recuperación Semántica con BM25 Dual

En lugar de un único índice genérico, construí dos índices BM25 separados: uno para documentación y otro para código fuente. Esta separación evita que tokens de sintaxis contaminen la recuperación de docs y viceversa. Para la normalización, desarrollé tokenización avanzada de identificadores que divide snake_case y separa camelCase / PascalCase en palabras individuales. En modo combinado, el Retriever aplica interleaving de resultados (zip) para garantizar un contexto balanceado entre explicaciones técnicas y referencias de implementación.

3. Generación con LLM Local y Evaluación de Métricas

El AnswerGenerator carga el modelo Qwen3-0.6B en GPU (CUDA/MPS) o CPU con precisión float16. Construye un prompt restrictivo — "Answer using ONLY the context provided..." — y genera hasta 100 tokens nuevos, truncando el contexto a 3500 caracteres para respetar la ventana del modelo. Finalmente, el Evaluator calcula métricas Recall@k comparando las fuentes recuperadas contra un dataset de ground truth, con lógica de solapamiento de caracteres que considera un hit si el ratio es ≥ 5%.